腾讯张潍丰:DDR内存池——GPU-CPU Scale Up互联的需求和挑战

近日,2026ODCC春季全会网络工作组会议在浙江舟山顺利召开。会上,腾讯网络架构师张潍丰发表主题分享,深入解析了DDR内存池化在GPU-CPU Scale-Up互联场景下的应用需求与实践挑战,并提出DDR内存池是GPU存储体系的最后一块拼图,是解决超长序列大模型推理难题的核心方案。

张潍丰

腾讯网络架构师

主题分享

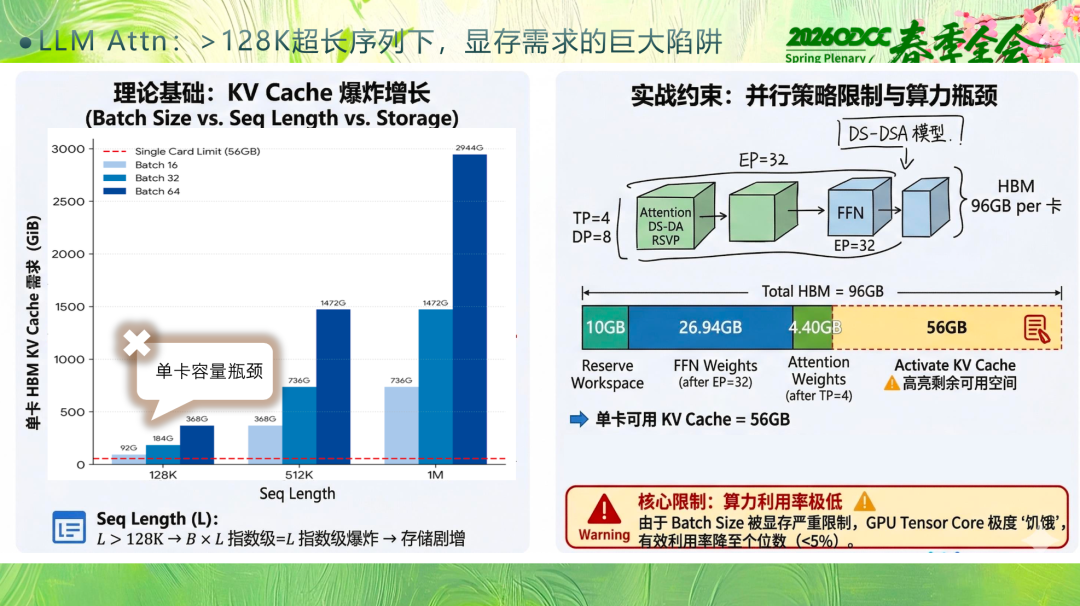

当前,大模型发展已进入长序列化推理的不可逆阶段,长上下文处理能力已成为提升推理场景用户体验的核心竞争力。当序列长度突破128K Token后KV Cache显存需求呈指数级爆炸增长,导致GPU HBM显存瓶颈凸显,算力利用率降至个位数,成为制约大模型规模化落地的关键障碍。

在大模型Attention计算环节,序列长度的指数级增长直接带来存储需求的急剧攀升。即便单卡配备96GB HBM显存,经张量并行与专家并行优化后,单卡可用KV Cache空间仅56GB。显存容量的刚性约束,直接导致Batch Size被严重压缩,GPU Tensor Core算力单元长期处于“饥饿”状态,有效算力利用率跌至50%以下,造成了昂贵AI算力资源的浪费。

与此同时,现有GPU分层内存体系存在显著的带宽与容量断层。从GPU核心缓存、直连HBM,到Host内存、本地SSD乃至集群存储,带宽从TB/s级别下跌至GB/s级别,在HBM与Host内存之间,存在着带宽的缺口,亟需可挂载于Scale Up网络的DDR内存池填补空白。

针对上述行业痛点,张潍丰在分享中系统规划了DDR内存池的硬件平台架构与技术落地路径。该方案设计了两种核心系统形态,分别为集成IOD的CPU内存池与专用内存节点,同时针对性设计Scale-Up专用DMA引擎,深度适配推理、推荐等核心AI场景的访存模式,可实现基于Scale-Up域内向每GPU提供约300~600GB/s的TB级别容量访存能力,在成本可控的前提下,填补现有内存体系的空白。

当前,DDR内存池相关项目已进入正式研发推进阶段。2026年作为技术落地关键年,腾讯将重点完成核心技术原型测试、软件框架开发与生产环境业务验证,为AI算力基础设施升级提供核心技术支撑,助力大模型技术更高效、更经济地落地应用。

ODCC网络工作组联系人

孙老师 suncong@caict.ac.cn

ODCC秘书处联系人

刘老师:13488889649 邮箱:liupengyun@caict.ac.cn