聚合计算+ CXL:并行实例KV Cache共享机制探索

聚合计算+ CXL

大模型推理正迈入“规模化、持续化、在线化”的新阶段:越来越多的业务场景从离线评测转向实时在线服务,部署模式也由单点实例演进为支持多租户、多实例、高并发的集群架构。在此过程中,推理成本与端到端时延成为制约落地成效的关键因素—尤其在长上下文处理、多轮对话、检索增强生成(RAG)以及智能体编排等复杂应用中,KV Cache(Key/Value Cache)对显存与系统内存的占用急剧增长,已成为限制系统吞吐能力与运营成本的核心瓶颈之一。

在此背景下,面向AI云原生基础设施的“聚合计算”架构正在重新定义算力与存力的供给范式。通过CXL(Compute Express Link)等新一代高速互连技术,异构硬件资源得以统一池化并实现细粒度的弹性调度,使计算与内存资源具备类似“水电”般的按需分配与动态流动能力。

本文以“聚合计算 + CXL扩展内存”为技术切入点,探讨其在多推理Pod环境下实现KV Cache共享的潜在价值、概念架构及关键工程实现要点,旨在为相关技术路径的探索与实践提供参考。

一、多推理 Pod 的 KV Cache痛点分析

在大模型推理中,KV Cache 用于保存历史token的注意力中间结果,避免每次生成都从头计算。KV Cache 的规模通常随上下文长度、batch、并发会话数、模型层数与隐藏维度线性或近线性增长,具有如下特征:

上下文越长,KV Cache 越大;

并发请求越多,KV Cache 叠加越快。

由于 KV Cache 通常驻留在 GPU 显存或主机内存中,系统资源极易迅速耗尽。

在Kubernetes +多推理 Pod(多副本)形态下,常见问题会被进一步放大:

集群冗余浪费:同一模型为保障高可用与弹性扩缩容而部署多个副本时,每个 Pod 独立维护各自的 KV Cache,导致缓存空间大量重叠,形成集群层面的资源冗余。

显存/内存瓶颈抑制吞吐:为给KV Cache腾出空间,实例不得不压缩批次大小、截断上下文或触发高频缓存淘汰,进而拖累整体吞吐量与响应时延。

热数据跨实例复用困难:同一用户会话、多轮对话延续、相同知识库检索路径等场景下的相似上下文,因缓存分散在不同副本而难以共用,造成计算与存储开销的重复。

因此,推理系统真正欠缺的并非单纯的存储容量增加,而是一种能够实现缓存池化、跨实例共享、按需弹性供给的内存能力。

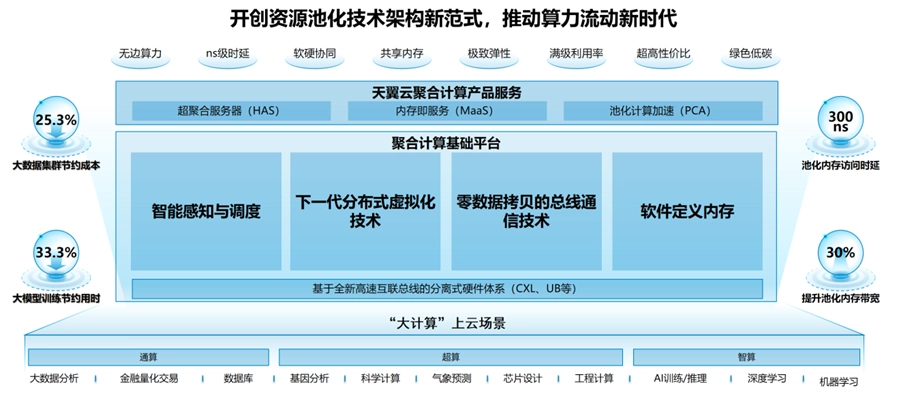

二、聚合计算 + CXL:“内存即服务(MaaS)”模式探索

聚合计算强调“资源池化 + 软硬协同”,把原本绑定在单机上的 CPU/GPU/内存/存储/网络资源,解耦并纳入统一编排。

映射到推理场景中,可以理解为:

把内存从“某台服务器上的固定容量”变成“集群级可调度资源”;

通过高速互联(如 CXL)把扩展内存纳入可访问域,提供更接近本地的时延/带宽特性;

由软件栈(虚拟化/容器运行时/内存管理/调度器)实现 低延迟访问、配额隔离、弹性伸缩与可观测计量。

从推理过程中键值缓存(KV Cache)的共享与外置视角出发,CXL(Compute Express Link)技术通过将内存资源从主板解耦,使其成为可平台化调度与交付的基础设施级资源。该能力在大模型推理场景中的价值主要体现在以下三个方面:

更接近本地内存的访问特性:相对传统网络远端内存,CXL 在时延与带宽上更有优势;

内存池化(Memory Pooling):将多块内存资源统一成池化能力,按需切分与分配;

为共享/一致性提供硬件基础(视模式与实现):在合适的 CXL 模式与软硬件实现下,为多计算端访问同一片扩展内存资源提供更好的基础。

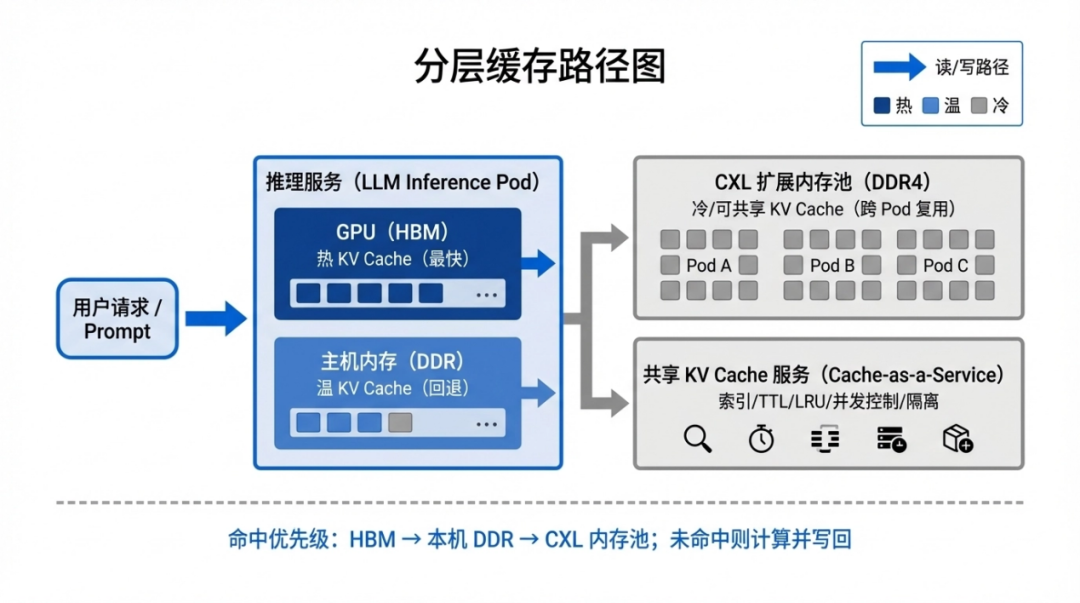

三、概念架构:多推理Pod的KV Cache共享(Cache-as-a-Service+ MaaS)

下图为一种基于 CXL DDR4 内存池的参考架构,用于分析 KV Cache 由进程内私有缓存向集群级共享缓存的演进机制。

#1 资源层:CXL DDR4 内存池

算力中心部署CXL内存扩展设备(DDR4),形成可切分的内存资源池,通过聚合计算基础设施把内存池纳入统一管理、监控、计量与调度,可支持按租户/按命名空间隔离,按Pod/按服务等级弹性分配。

#2 平台层:KV Cache 共享服务

(Cache-as-a-Service)

在集群内提供一个“KV Cache 共享服务”,核心能力包括:

Cache 分片与索引:按模型/会话/请求特征或 token 序列组织;

生命周期管理:TTL、LRU、冷热分级策略、回收;

并发控制:多 Pod 同时读写时的锁/版本/幂等机制;

安全隔离与审计:租户隔离、访问控制、用量审计。

关键变化在于:KV Cache 从“Pod 私有状态”走向“平台共享状态”。

#3 工作负载层:多推理 Pod(多副本、多实例)

在该架构中,每个推理Pod仍承担模型加载与计算任务,但无需为所有会话维护完整的KV Cache,而是采用分层与外置策略:将高频访问的热KV Cache保留在本地高速存储介质(如 HBM 或本机 DDR)中,而将低频或可跨会话共享的冷KV Cache卸载至基于CXL 互联的远程内存池。当需要访问外置缓存时,可通过低开销的地址映射或直接内存访问机制高效获取,从而在保障性能的同时提升内存资源利用率。

四、价值分析

将KV Cache与CXL扩展内存池相结合,将在提升容量上限、优化成本、改善弹性伸缩体验等方面释放潜在价值:

长上下文更从容:KV Cache不再受限于单机内存或显存的物理容量约束,从而为长上下文处理和多轮对话场景提供更稳定、可扩展的缓存支持。

降低重复缓存带来的集群浪费:多个 Pod 副本无需各自独立缓存相同的 KV Cache,从而提升整体内存资源的利用率。

扩容不必从零开始:新扩出的推理 Pod 在一定条件下可从共享池读取已有 cache,降低冷启动影响。

多租户运营能力增强:共享 KV Cache 可纳入平台化运营:按租户计费、按优先级分配、按 SLA 保障。

与聚合计算产品形态高度契合:它与“内存即服务(MaaS)”理念一致,即内存从静态资产变成可编排、可服务化交付的能力。

作者

邵剑峰 shaojianfeng@caict.ac.cn

李光辉 ligh10@chinatelecom.cn

黄涛 huangt40@chinatelecom.cn

审核

谢丽娜 xielina@caict.ac.cn

ODCC秘书处联系人

刘老师:13488889649 邮箱:liupengyun@caict.ac.cn