ODCC | KV Cache测试实验室揭秘:超擎数智提供高性能系统级验证环境

随着大模型进入“长跑”时代,算力瓶颈正在悄然转移。从8K到128K,再到如今百万级的Token上下文,大模型的“记忆力”正在经历爆发式增长,同时也对显存容量以及数据带宽需求提出了更高要求。

为实际验证KV Cache存储解决方案在实际推理场景中的效能,ODCC联合NVIDIA 、超擎数智、 焱融科技、英韧科技、DaoCloud、纳多德等企业,依托超擎自有的高性能计算和人工智能研发测试中心,投入数千万设备,进行了一场跨厂商多元方案的深度验证。

一、核心思路:高性能网络打通存算高速通道

面对显存瓶颈,业界普遍认可KV Cache Offload技术,即将显存装不下海量的KV缓存数据,卸载至外部存储,需要时再快速取回。在PD分离架构中,同样也是这一思想:Prefill节点产生的海量KVCache可以迅速卸载到共享存储池,而Decode节点则能以极低延迟拉取所需缓存,从而实现真正的计算与访存分离。

但是,无论是PD分离还是KV Cache Offload的解决方式,关键取决于连接计算与存储的那条“高速公路”——网络带宽。

因此,为系统评估高速网络环境下KV Cache卸载带来的性能收益,本次测试基于NVIDIA Spectrum-X的高速网络环境,分析东西向和南北向高带宽网络对AI推理性能的影响。

二、测试环境:软硬件协同的全栈验证平台

本次测试是涉及算力、网络、存储、算法的全栈系统工程,其中作为核心硬件方案提供商,超擎数智依托其拥有的全套真实环境的计算网络硬件资源,以及整合从底层的DPU/DOCA开发到上层的AI软件栈优化的全栈技术能力,承担了高性能服务器与测试环境的关键支撑角色,为系统级验证的顺利落地提供了坚实保障。

具体环境配置如下:

平台层:采用Dao Cloud Enterprise 5.0 (DCE 5.0)。

模型负载:实测DeepSeek-R1(671B)和Qwen3(235B)等主流大模型,上下文长度分别拉满至128K、40K。

计算层:覆盖了高端与中端两类典型推理计算平台。

网络层:部署了基于 NVIDIA Spectrum-X 的以太网架构,提供从400G到1.6T的超宽带“高速公路”东西向网络。

存储层:采用焱融YRCache高性能推理存储系统、英韧洞庭N3X SSD,专为缓存命中优化。

三、实测深度解读:高带宽网络重塑推理性能

本次测试通过两组核心场景验证了高带宽网络对KV Cache卸载架构的决定性影响。

PD一体测试场景

1 带宽即算力:

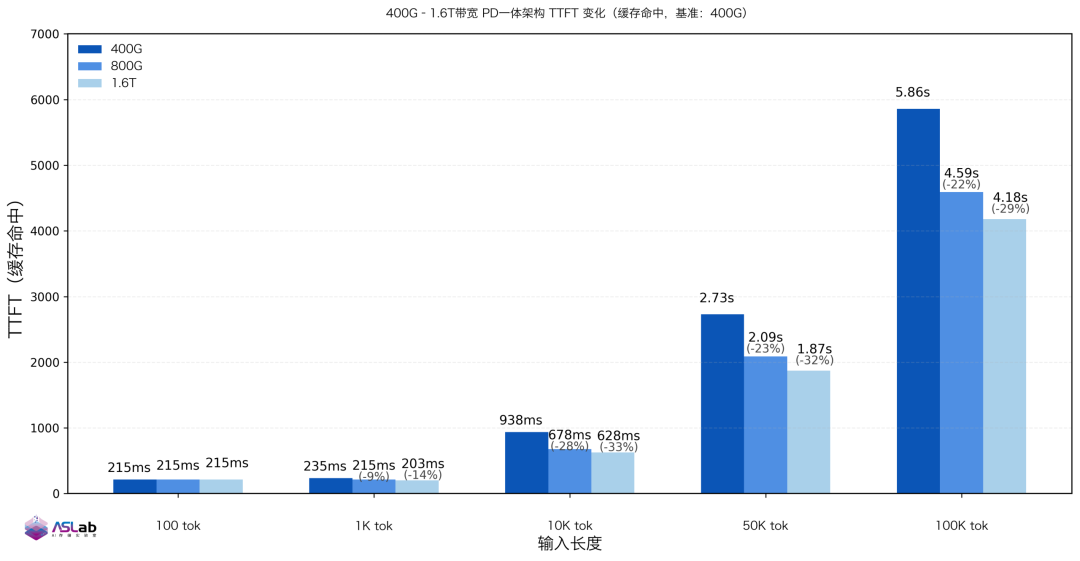

1.6T网络带来的性能飞跃

测试中,通过在高端GPU平台运行DeepSeek-R1(671B)模型,模拟100至100KToken的超长文本推理,对比不同东西向和南北向带宽下的TTFT,发现带宽升级带来的收益随上下文长度增加而显著放大:当东西向的带宽从基准的400G提升至1.6T时,100K场景下的TTFT降低了29%。

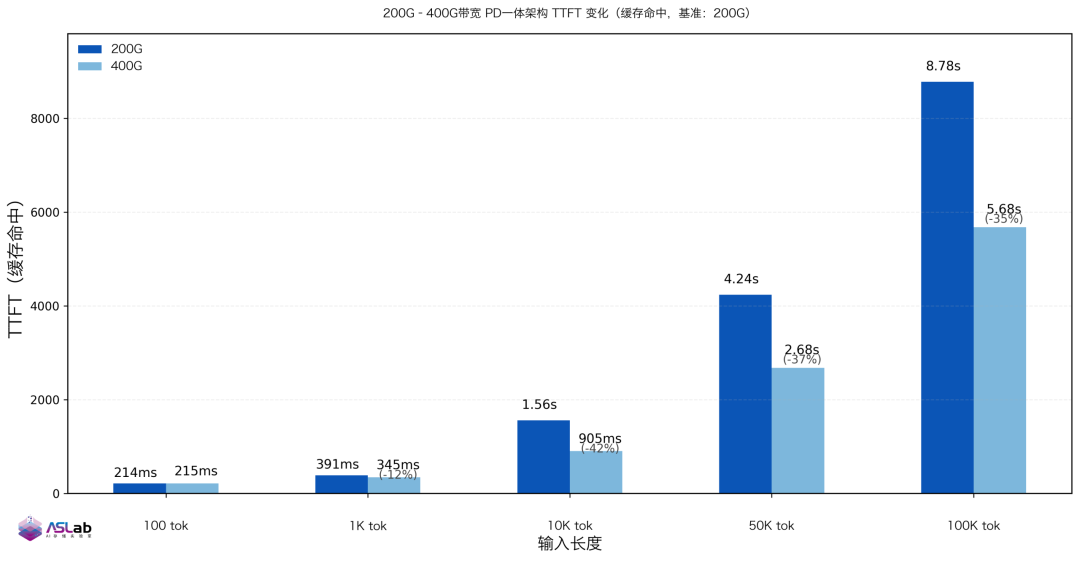

另外,测试中南北向网络同样承载了GPU-存储的流量。通过将其带宽从200G升级至400G后,延迟大幅降低了35%。

通过以上数据可以看出,在PD一体架构中,通过每提升一档带宽,首字延迟(TTFT)就显著降低,充分表明当缓存需要频繁跨网络迁移时,网络带宽成为影响端到端推理吞吐能力的关键因素。

2 颠覆性发现:

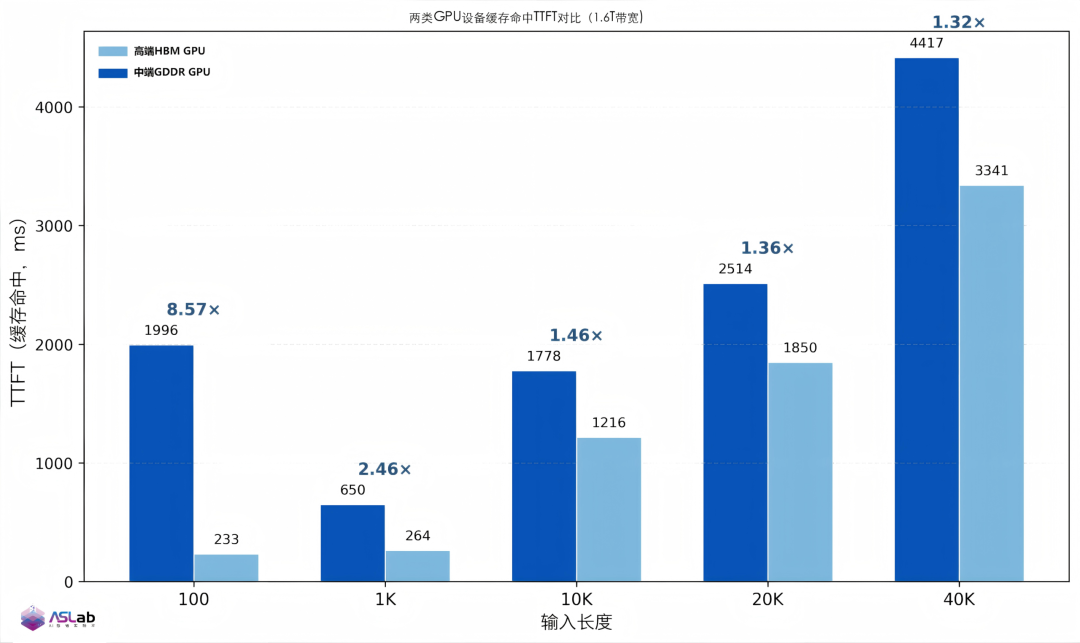

高带宽能“拉平”GPU 的性能差异

通常中端GPU在性能上无法与高端GPU相提并论。但在本次测试中,在超长文本(40K Tokens)场景下,同时配置了1.6T的超高速网络进行KV Cache卸载时,两者的性能差距被显著地缩小至1.3倍左右。

通过以上数据可以看出,长文本场景下瓶颈已从“计算瓶颈”转移到了“IO 瓶颈”。此时,网络的吞吐能力取代了GPU的浮点算力,成为了决定性能的主要因素。

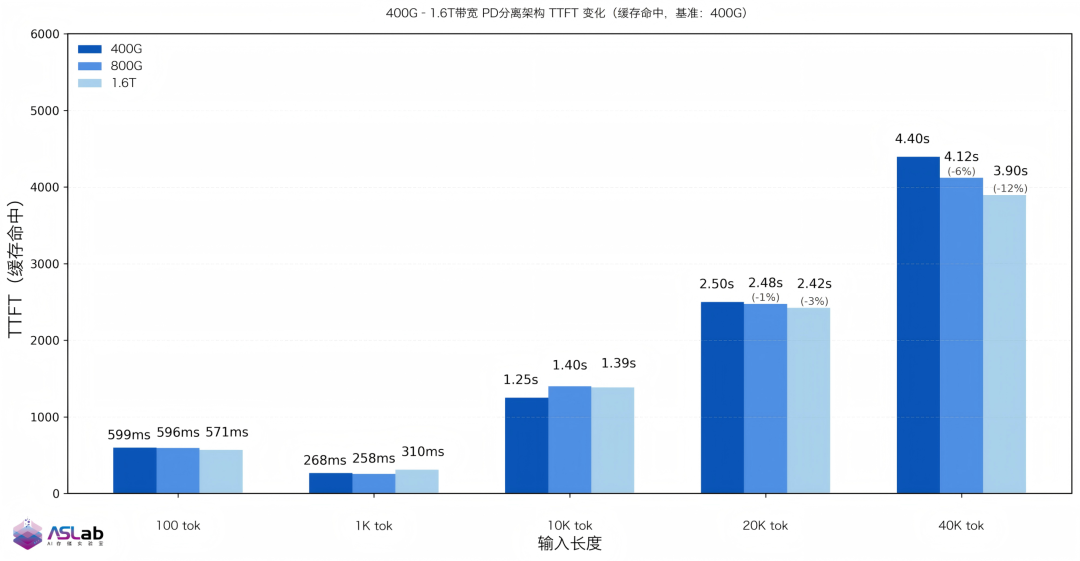

PD分离测试场景

在PD分离测试中,使用低端GPU服务器作为Prefill节点、高端GPU服务器作为Decode节点,基于Qwen3(235B)模型进行长文本测试。数据显示,在40K Token长文本下,1.6T带宽相比400G降低了12%的延迟。

通过以上数据可以看出,虽然优化幅度较PD一体场景有所收窄,但这12%的提升不仅意味着用户体验的改善,更预示着未来随着Prefill节点算力增强或流水线深度优化,网络可能再次成为瓶颈。届时,这12%的优势将转化为更大的性能空间。

总结 网络成为AI推理的算力放大器

两组实测结果表明:网络带宽的价值随着架构的演进逐步释放。在PD一体架构中,它是制约性能的核心瓶颈;在PD分离架构中,则成为进一步优化的关键环节。但是无论哪种架构,高带宽环境都能为长上下文推理带来切实的性能提升。这也表明,依托高速互联带宽,KV Cache Offload具备了真实落地应用的可行性。

未来,ODCC将以此次系统级测试为基础,持续联合超擎数智等产业链伙伴,聚焦AI原生基础设施创新,加速推动网络、存储与算力的深度融合,将先进算力转化为产业生产力,助力AI深度赋能千行百业,驱动数字经济高质量发展。

ODCC AI存储实验室联系人

段老师:16600265822

谢老师:18800199616

ODCC秘书处联系人

刘老师:13488889649 邮箱:liupengyun@caict.ac.cn