构建企业级安全「龙虾池」的挑战与应对策略

2026 年 AI 智能体领域迎来全面爆发,OpenClaw 作为开源 AI 智能体的代表,凭借自主完成数据处理、文件管理、邮件处理等复杂工作的出色表现,快速风靡全球科技行业,成为企业与开发者青睐的高效生产力工具,广泛落地办公自动化、业务流程管理等多元场景,开启了 AI 从 “对话交互” 迈向 “自主执行” 的全新发展阶段。然而,从开源社区的技术验证到企业级规模化部署之间,仍面临着技术、安全等诸多挑战,也对硬件设施提出了更高要求。

一 开源OpenClaw企业落地面临的困境

(一)终端安全风险突出,数据防护能力不足

OpenClaw的核心价值在于“自主执行”,这要求其必须被赋予访问本地文件系统与外部服务的极高权限。在缺乏底层安全加固的终端环境下,这不仅容易导致管理端口暴露、第三方插件供应链污染,更易因大模型的指令偏差,引发机密数据误删或越权外发等严重安全事故。

(二)数据外传风险高,合规管控难以落地

单机版智能体高度依赖云端大模型API进行推理。在此架构下,企业核心业务数据不可避免地需要上传至公网环境。这种数据流转方式不仅缺乏细粒度的访问控制与全链路审计机制,不符合金融、政务、制造等行业严苛的数据本地化合规要求。

(三)Token消耗失控,使用成本居高不下

复杂业务场景下的长上下文处理与多步骤任务编排,会产生巨大的Token消耗。在多用户并发调用云端API的模式下,企业的使用成本呈指数级增长,导致智能体项目陷入“部署门槛低、长期运营成本极高”的局面。

(四)部署运维复杂,技术门槛制约普及

配置繁琐,需手动调试环境、适配插件,持续更新维护成本高,skill库匮乏难以匹配业务需求,导致实用性不足,团队普及率低。

二 核心应对策略

针对OpenClaw企业落地面临的困境挑战,结合工业和信息化部网络安全威胁和漏洞信息共享平台发布的“六要六不要”安全建议及当前产业界的实践案例,可从以下四个维度梳理相应的解决路径。

(一)部署环境的系统化安全加固

针对OpenClaw默认安全配置薄弱、管理端口易暴露于公网的问题,部署方需在环境准备阶段实施系统性的安全检查:

严格控制互联网暴露面:不应将OpenClaw实例直接暴露于公共互联网。若确需远程访问,应通过SSH等加密隧道,并限制访问源IP地址范围,采用高强度密码或多因素认证。

落实最小权限原则:仅授予完成必要任务所对应的最低权限。对删除文件、发送数据、修改系统配置等高风险操作,应设置人工确认环节。建议优先采用虚拟化实例进行隔离运行。

(二)大模型与知识库本地化部署

针对数据合规与防泄漏问题,解决方法是将大模型推理与企业私有知识库完全部署于企业内部网络,实现数据流转的闭环管控:

模型本地化:推理计算在本地服务器完成,用户输入的Prompt、模型输出的结果以及中间计算结果,全程不跨出企业网络边界。

知识库本地化:知识检索、召回、生成均在本地完成,杜绝因上传至公有云知识库而导致的数据泄露风险。

(三)大模型与知识库本地化部署

针对Token消耗问题,本地化部署同样是重要解决方案,一次性硬件投入后后续使用成本趋近于零。在必须保留部分云端调用的混合场景中,也可通过上下文压缩与等手段,避免重复计算相同或相似的请求内容,进而降低重复调用的Token开销。

(四)集群化管理与统一标准化部署

针对多用户场景下实例版本碎片化、技能配置不规范、运维复杂度指数级上升的问题,应对思路是“集约管理”与“标准化镜像”:

集群化管理平台:采用Kubernetes等容器编排架构,将多个OpenClaw实例的部署、升级、鉴权、配额分配及全生命周期监控纳入统一控制面。通过中心化管理入口,支持多个实例的一键部署、集群统一升级及技能批量迁移。

开箱即用:将经过安全加固的OpenClaw环境打包为标准化容器镜像。用户部署时仅需拉取镜像并完成简单配置,显著降低技术门槛。

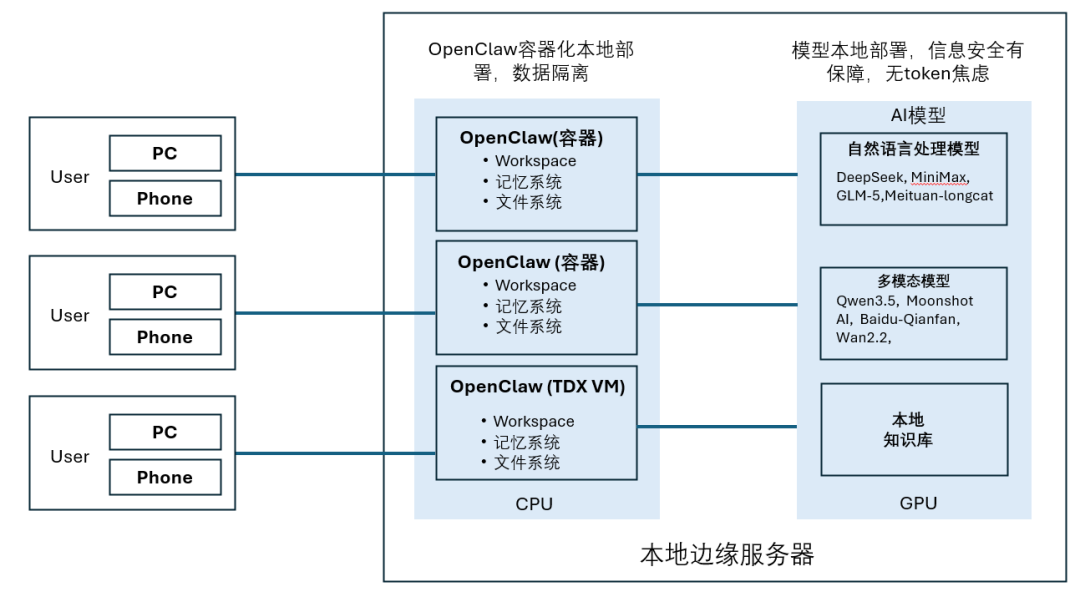

三 技术方案参考

业界积极推进解决方案的研究与开发,英特尔推出企业级OpenClaw解决方案。该解决方案以本地部署、安全可控为核心,采用OTII 边缘AI服务器+多GPU硬件底座,构建虚拟化多实例、本地大模型与知识库、硬件级安全防护三位一体的软件体系,实现OpenClaw企业级规模化安全应用,旨在解决安全、成本、运维三大核心问题。

解决方案核心特点:

本地闭环:大模型与知识库完全本地化,数据不出内网

多用户隔离:虚拟化实例实现物理级数据隔离

硬件安全:Intel TDX/AMX技术提供芯片级防护

零Token成本:摆脱云端API依赖,使用成本大幅降低

开箱即用:标准化部署,降低运维技术门槛

硬件平台部分,采用符合OTII/OTII-E规范的边缘服务器和通用AI服务器,支持配置高性能GPU与大容量混闪存储。

软件架构部分,支持容器/虚拟机OpenClaw多用户集群部署,支持本地大模型与私有知识库,并为小模型提供AMX加速能力。针对Token消耗问题,采用分层摘要+动态窗口压缩方案,通过提取关键信息,严控Token占用,减轻模型推理负载,提升长会话、多任务复杂场景下的运行稳定性。

安全体系部分,依托Intel TDX可信域加密技术,为AI推理、数据运算构建独立可信隔离域,实现模型运算、数据读取、指令执行全程硬件加密,从芯片级别加固安全底座。

作者

高纪明, jiming.gao@intel.com

马建伟,jianwei.ma@intel.com

邵剑峰,shaojianfeng@caict.ac.cn

审核

谢丽娜 xielina@caict.ac.cn