百度吴镇生:边缘大模型高效推理中的精准调度与缓存优化

当前,大模型应用正加速向边缘侧延伸,推理场景从中心化部署向分布式、实时化、场景化演进。随着多模态交互、智能终端协同和业务实时响应需求持续提升,边缘大模型推理对显存承载能力、请求调度效率、跨设备传输能力和系统稳定性提出更高要求。传统依赖单点算力扩容的优化方式,已难以适配边缘侧高并发、低时延、强波动的复杂场景,系统级协同优化正成为边缘推理提效的重要方向。

当前边缘大模型推理规模化落地过程中,行业普遍面临显存瓶颈、传输瓶颈、调度瓶颈和协同瓶颈四类关键挑战,其具体表现为:

一是显存瓶颈制约缓存承载能力。

边缘节点显存容量有限,热点请求集中、上下文长度增长等因素叠加,使KV Cache占用快速攀升,成为影响推理吞吐和首Token时延的重要约束。在这一背景下,如何在有限显存条件下提升缓存利用效率,已成为边缘推理优化的重要前提。

二是传输瓶颈抬升跨设备协同成本。

推理过程中频繁发生缓存搬运和阶段切换,跨设备数据传输一旦效率不足,便容易引发额外等待开销,进一步放大显存压力与推理阻塞问题。如何降低数据传输成本、减少阶段切换损耗,直接影响边缘推理系统的整体响应效率。

三是调度瓶颈影响请求路由精度。

面对高并发请求与动态资源波动,若调度机制仅依据算力空闲程度进行粗粒度分发,难以充分利用缓存命中、节点健康和实时负载等信息,容易造成实例利用不均、响应时延波动等问题。

四是协同瓶颈限制系统级提效空间。

边缘推理优化不再只是单节点上的显存管理问题,还涉及设备侧、节点侧与集群侧的分层缓存协同。只有形成多层联动机制,才能在复杂场景中兼顾性能、稳定性与资源利用率。

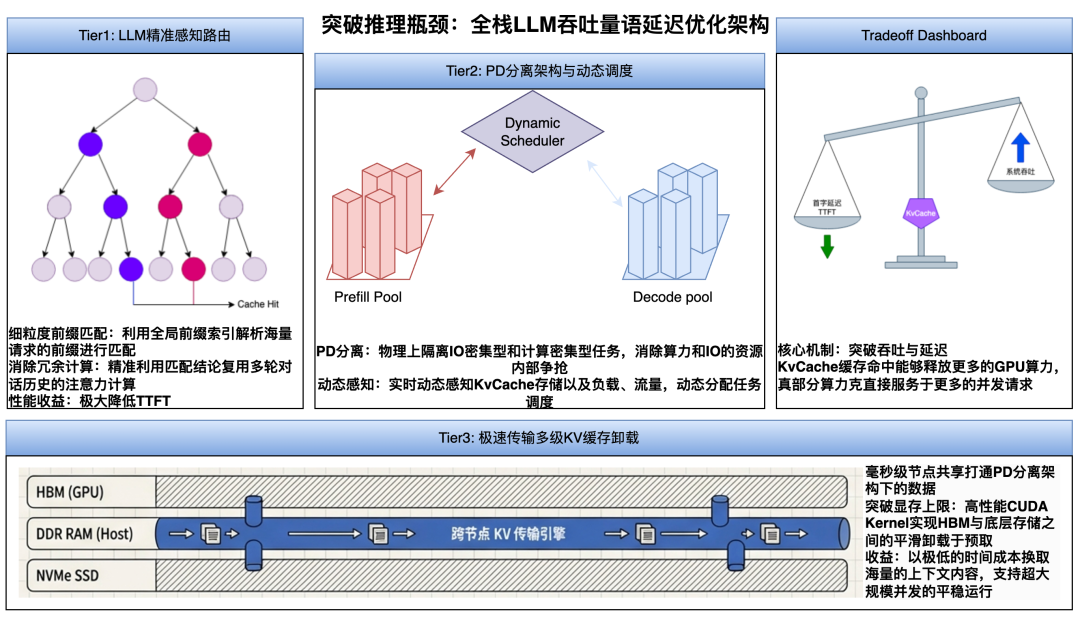

围绕边缘大模型推理中的关键瓶颈,分享从“数据传输—缓存调度—分层存储—集群协同”四个维度梳理了系统化提效路径:前端通过PD分离降低推理负载耦合,中间通过缓存感知调度实现精细化路由,后端通过共享缓存、多级缓存与热复制机制扩展可用缓存空间,逐步形成面向边缘场景的高效推理体系。

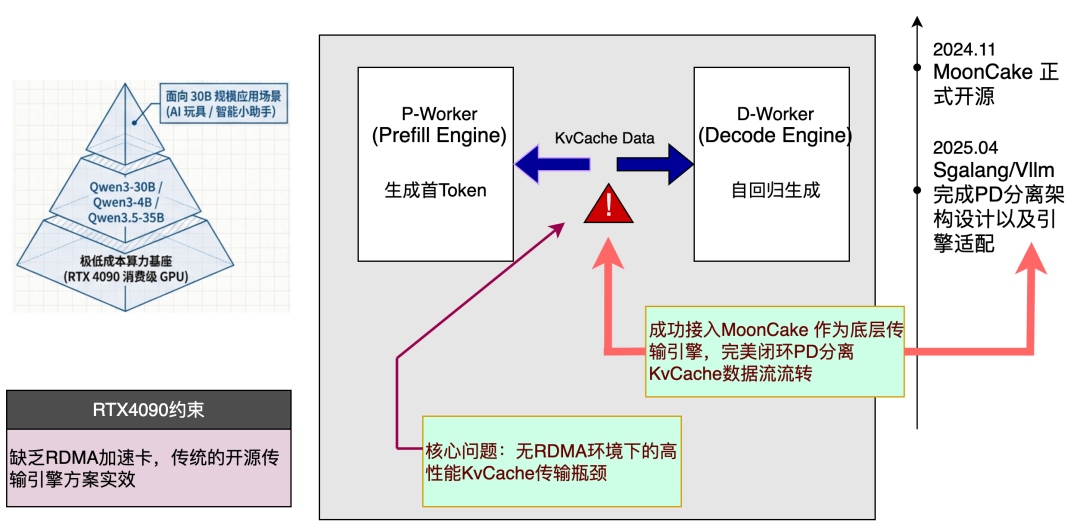

PD分离与高效传输协同

在PD分离环节,重点讨论了基于P2P传输的KvCache传输引擎。其核心思路是在边缘推理过程中,将Prefill与Decode阶段进行更细粒度的拆分,并通过高效的缓存搬运机制减少跨设备传输带来的等待时间,从而缓解显存压力与推理阻塞问题。

图1 基于P2P传输的KvCache传输引擎

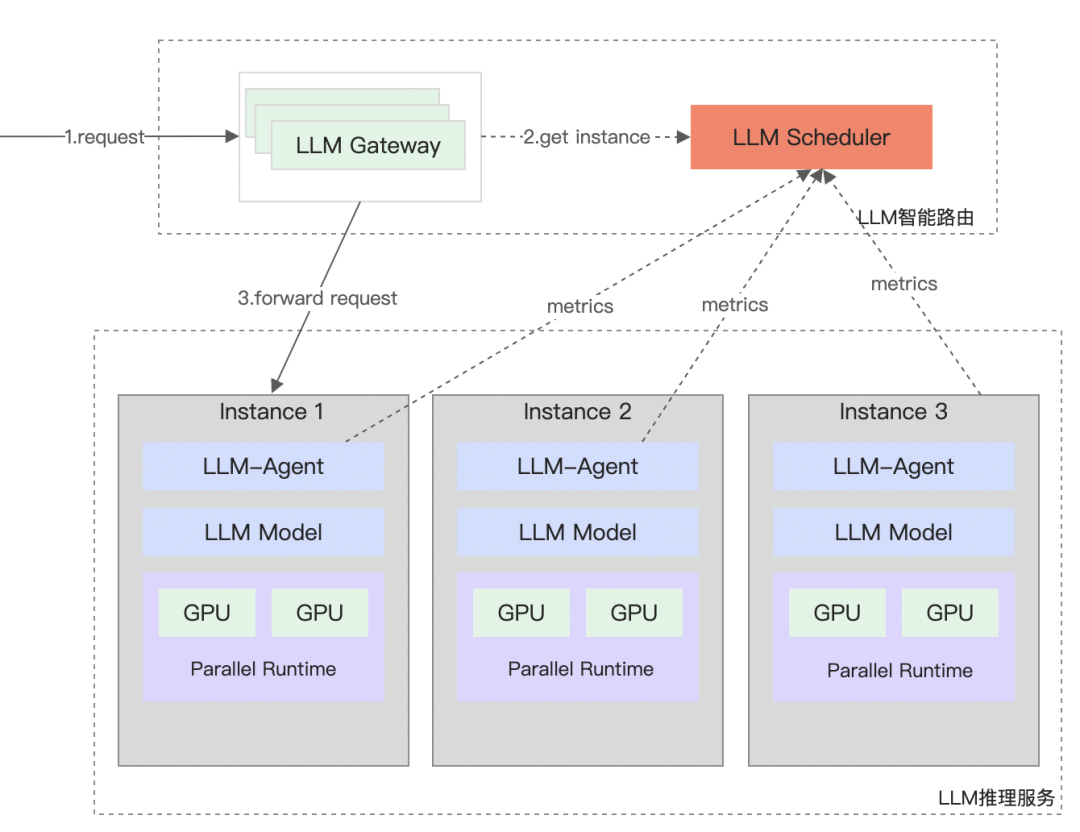

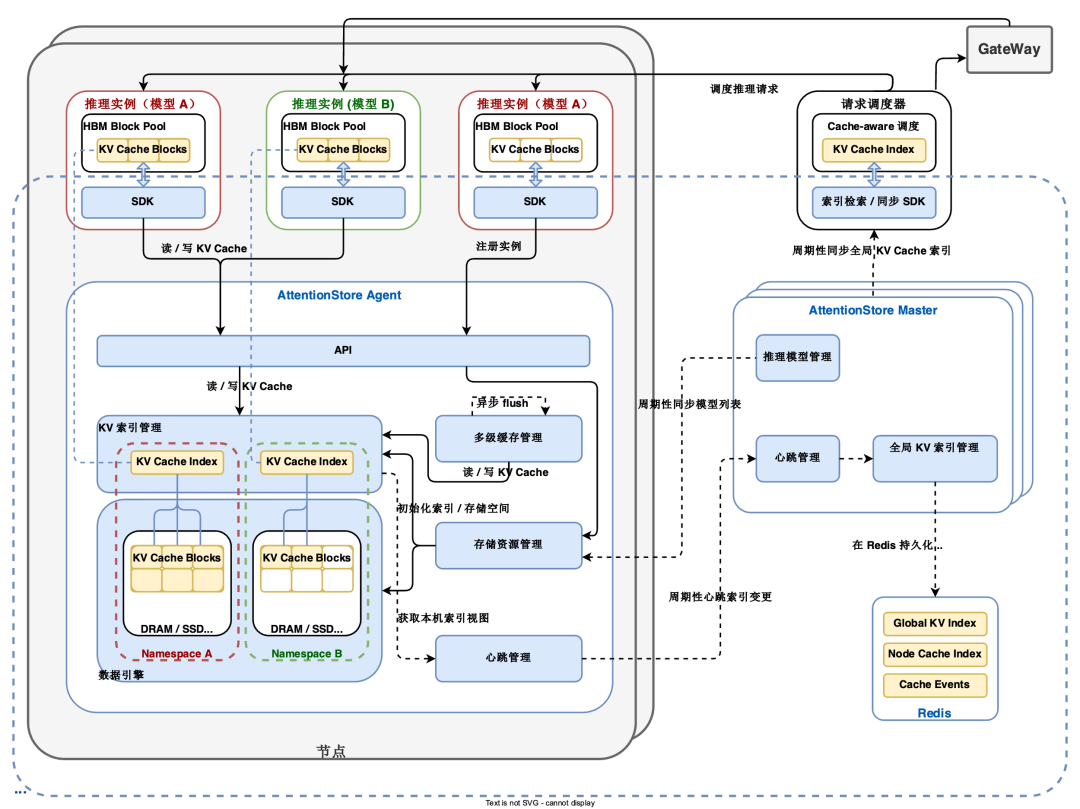

缓存感知调度机制升级

在缓存感知调度方面,系统引入Gateway、Scheduler与推理实例协同机制:前端接入层负责高可用流量分发,调度层负责全局决策,实例侧则持续上报缓存与负载信息。这样一来,调度不再只看算力空闲程度,而是能够综合缓存命中、节点健康与负载状态进行更精准的请求路由。

图2 基于负载感知的早期智能路由

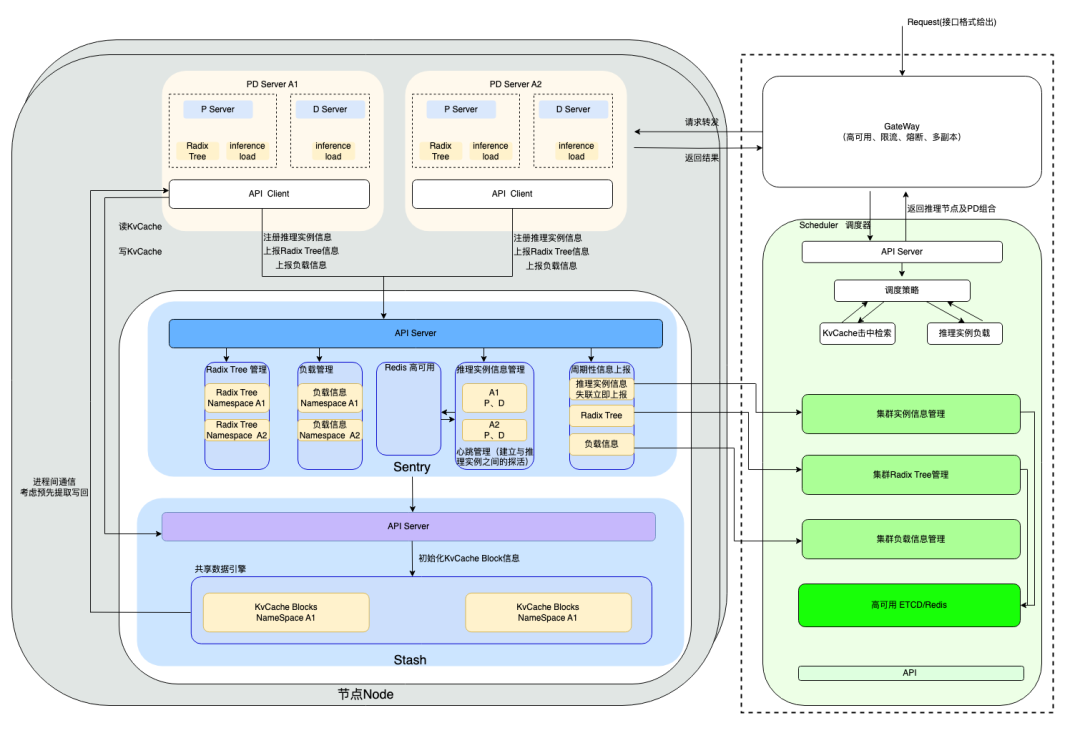

共享缓存与热复制策略落地

围绕边缘节点显存受限这一突出瓶颈,分享提出了扩展共享缓存与热复制的优化思路。通过KvCache卸载、节点间共享以及高速D to H、H to D传输Kernel,系统能够在不显著增加等待时间的前提下扩展可用缓存容量,并通过热复制降低热点请求的重复构建成本。

图3 共享缓存与热复制策略

多级缓存体系协同演进

从更广义的体系设计看,多级缓存不只是单节点上的显存管理问题,而是要形成从设备侧、节点侧到集群侧的分层协同。分享中的多级缓存设计展示了面向A/H系列平台的适配思路,强调通过不同层级缓存的分工与联动,提升资源利用效率并改善推理时延表现。

图4 A/H系列上的多级缓存设计

结语

边缘大模型推理系统优化正在从“单点算力提升”走向“缓存协同优化”。前一阶段行业更多关注算力规模、显存容量和单机性能,下一阶段则更加关注KvCache管理、调度策略、共享缓存和系统级协同效率。对产业界而言,核心目标不再只是叠加硬件资源,而是通过缓存感知与多层缓存优化,持续提升推理吞吐、降低时延波动、增强系统稳定性与资源利用率。随着边缘推理场景不断丰富,围绕PD分离、精准调度和多级缓存协同构建高效推理体系,将成为推动边缘智算基础设施演进的重要方向。

图5 整体思路总结

作者:百度在线网络技术(北京)有限公司,算法工程师,吴镇生

ODCC边缘计算工作组联系人

周 曼 13810136860(微信同号)邮箱: zhouman@caict.ac.cn

何绪东 17801778925(微信同号)邮箱: hexudong@caict.ac.cn