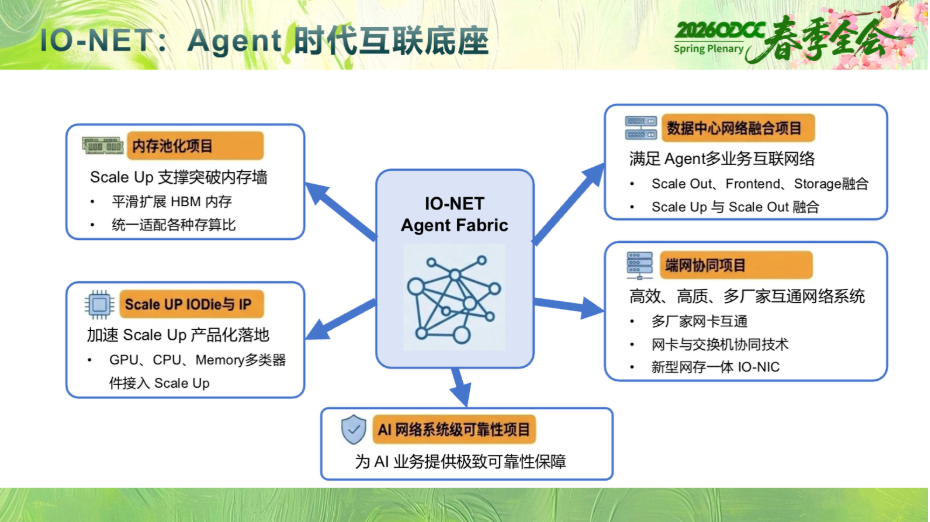

破局四大壁垒!IO-NET构筑Agent时代AI互联底座

当前,人工智能技术加速迭代演进,行业发展步入进阶周期。2024年大模型训练实现全球普及,2025年推理能力迎来全面爆发,2026年正式迈入Agent时代。AI从“被动响应”向“自主执行”转型,自主规划、调用工具、完成复杂任务,成为驱动数字经济高质量发展的新型生产力。范式变革对底层AI基础设施提出全新的挑战,传统网络架构在海量设备协同、资源高效调度、系统稳定运行等方面短板凸显,难以适配Agent时代的发展需求。ODCC牵头启动IO-NET,聚焦下一代AI网络互联底座,开展全栈技术研究,着力破解行业发展瓶颈,为Agent时代筑牢基础设施支撑。

当前Agent规模化落地进程中,行业普遍面临内存墙、互联墙、可靠性墙、互通墙四大核心壁垒,严重制约算力效能释放与产业生态健康发展。

一是“内存墙”制约算力释放,显存供需矛盾突出。

当前大语言模型朝着超长序列方向快速发展,token序列长度从4K、128K向1M量级跨越,显存需求呈指数级膨胀。以128K序列的Attention计算为例,KV-Cache的显存占用已经成为制约模型运行的关键瓶颈,单卡HBM容量难以满足实际需求。同时,GPU内存体系存在明显短板,在高速但容量有限的HBM与海量但访问缓慢的远端存储之间,缺乏高效的中间缓存层,类似CPU多级缓存体系的缺失,导致数据调度成本过高,严重影响算力利用效率。

二是“互联墙”导致设备协同不畅,标准碎片化问题突出。

AI计算正朝着异构化、解耦化方向发展,GPU、CPU、内存池、存储等核心组件来自不同厂商,需在Scale-Up网络中实现高效协同,但当前行业存在明显的标准碎片化问题。

1. 总线标准碎片化。NVLink、UALink、CXL、PCIe互不兼容。

2. IO Die(IOD)深度绑定。计算芯粒与IO芯粒紧耦合,更换芯片厂商需重新设计互联架构,增加产业发展成本。

3. Scale-Up接口缺乏统一规范。不同厂商XPU接入同一Scale-Up交换网络难度较大,制约异构设备协同效能。

三是“可靠性墙”加剧系统运行风险,难适配7x24小时。

随着AI集群规模持续扩大,从64卡向64K甚至100K+卡升级,光互联逐步取代电互联成为行业主流,但光互联的故障率比电互联高出1-2个数量级,光模块故障、光链路闪断、光通道损坏等问题频发。如在两层多轨64K卡集群中,仅依靠端侧重传,系统平均故障间隔(MTBF)仅约0.3小时,系统可用度仅为99%,每年业务中断时间近90小时,难以满足Agent时代7x24小时不间断运行的AI业务需求,严重影响业务连续性和稳定性。

四是“互通墙”造成生态碎片化,运维与性能成本双高。

异构GPU机型混部已成为行业大势所趋,在Prefill-Decode分离等场景下,不同GPU机型协同工作可降低单token成本。当前的Scale-out网络面临严重的生态碎片化问题"物理连接"并不等于"高性能互联"。传统RoCEv2/DCQCN协议存在结构性缺陷,舍弃多路径、乱序处理等关键能力,依赖PFC无损网络避免丢包。在超大规模集群和长距离互联场景下,易出现时延抖动、有效带宽下降等问题。同时,各厂商各自推出自定义解决方案,逐包负载均衡、拥塞控制等实现标准不一,报文处理机制和格式互不兼容,导致运维管理复杂度呈指数级上升。

IO-NET以"Agent Fabric"为核心愿景,围绕DDR内存池、通用IO Die(IOD)、AI网络系统级可靠性、网络融合、AI网络端网融合等关键项目展开系统性攻关,着力构建适配Agent时代的下一代AI网络互联底座,推动AI基础设施从“能用”向“好用”“通用”升级。

IO-NET的核心价值并非单点技术优化,而是通过构建统一化全域互联底座,打通GPU、CPU、内存、存储、网卡等分散硬件单元,实现多模块高效协同、一体化调度运行。在传统架构中,各类硬件依托独立总线与私有协议互联。如NVLink承载GPU间高速互联,PCIe负责外设挂载,以太网实现跨节点组网通信,CXL承担内存扩展能力,各链路形成相互隔离的技术“烟囱”。跨模块数据交互均需经过协议转换,由此带来大量性能损耗、适配成本与集成开销,成为算力效率提升的内在桎梏。

IO-NET将从底层打通各技术链路壁垒,重构算力、内存、网络一体化架构,实现硬件资源弹性调度、接口标准统一兼容、网络全域稳定可靠、多网络架构深度融合,充分释放算力潜能、降低推理服务成本,拓宽产业开放协同边界,打造面向Agent时代、开放兼容、高效可靠的新一代AI算网基础设施。

作者

孙 聪 suncong@caict.ac.cn

张潍丰 wikkizhang@tencent.com

审核

王少鹏 wangshaopeng@caict.ac.cn