腾讯何泽坤:从 GPU 之战到效率之战,Agentic AI 基础设施正迈向存算网一体化

近日,2026ODCC春季全会在浙江舟山顺利召开。会上,腾讯基础网络中心总监、ODCC网络工作组组长何泽坤发表主题分享,提出AI基础设施竞争已从“GPU数量与单卡性能比拼”转向“系统效率竞争”,核心在于计算、存储、网络、调度及电力的协同能力。Agentic AI(智能体AI)的兴起是转变的核心驱动力。模型不再只是“一次请求、一次回答”,而是在更长上下文中持续执行规划、检索、调用工具、写入记忆和结果验证。基础设施承接的也不再是瞬时推理峰值,而是一个完整任务闭环的持续负载。

Agent 先改写推理,再倒逼基础设施升级

Agent对推理形态的重塑,正倒逼AI基础设施加速升级。公开资料显示,Google 已将上下文窗口从32K提升至1048576 token,长上下文检索命中率接近 99%;Claude Opus 4.6 在 Terminal-Bench 2.0 上,随着推理 effort 提升,任务完成率可由 55.1% 提升至 65.4%。表明基础设施的优化目标已经变化:关注点已从每秒token输出量,转向任务运行的成本、时延及完成率。

瓶颈正在从 FLOPS 转向 KV Cache

随着长上下文和多步执行成为常态,系统瓶颈也在迁移。Prefill 阶段仍然偏计算密集,但在 Decode 阶段,模型需要持续回看历史 KV。一旦 KV 离开 GPU 本地 HBM,带宽就会从 TB/s 级下探到百 GB/s 甚至数十 GB/s,问题很快从算力问题转为 memory/IO 问题。尤其在 Agentic 场景中,KV Cache 复用率可高达 95%,未来决定系统上限的,不只是“算得快不快”,更是“历史状态能不能放得住、搬得回、调得巧”。

Network is the New Bus

针对这一行业变化,网络正在从传统的数据通道,升级为统一地址、统一搬运、统一调度的数据总线。GPU、CPU、DDR、SSD、DPU 也不再被割裂看待,而是被纳入统一的 AI Memory System。热数据和高频 KV 靠近计算侧,冷数据、日志和检索语料进入不同层级,系统再根据任务特征动态组织路径和资源。因此,超节点竞争不会停留在 GPU 数量堆叠。未来超节点规模将从 64 卡走向 512 卡以上,带上的不只是更多 GPU,还包括 DDR、SSD 和 CPU。下一阶段真正拉开差距的,将是 memory fabric、network fabric 与 KV-aware scheduler 的协同设计能力。

存算网一体化正在进入工程落地期

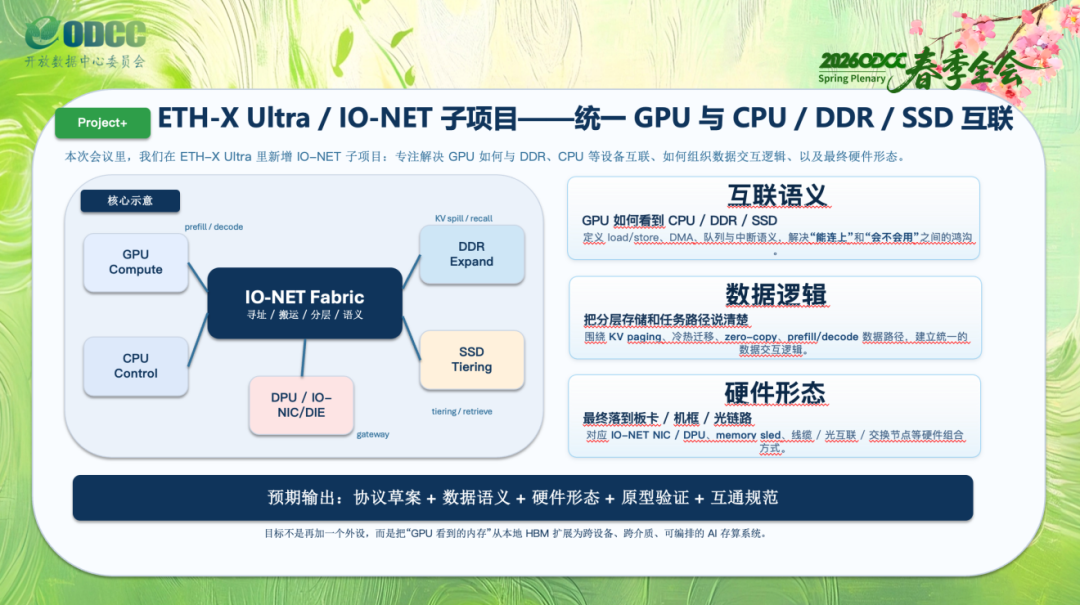

从工程落点看,ETH-X Ultra 中的 NPO 子项目正在把光引擎进一步贴近芯片,以缩短电域距离、提升大规模互联效率。何泽坤在分享中介绍了两大关键技术方向的进展。一是ETH-X Ultra中的NPO子项目正将光引擎进一步贴近芯,以缩短电域距离、提升大规模互联效率。NPO单光引擎总容量达到3.2T,采用 32×112G 通道设计,目标互联距离为30米,系统连接成本目标压到0.2 美元/Gbps以下。2026年2月,3.2T NPO产品已进入行业头部用户,6.4T NPO 标准也在推进中。二是 IO-NET技术。该技术重点解决“设备互联后,GPU如何以统一语义调用CPU、DDR、SSD等资源”的核心问题。因此,IO-NET 需打通 load/store、DMA、队列等互联语义,并组织好 KV paging、冷热迁移、zero-copy、Prefill/Decode 等关键路径。最终将“GPU 看到的内存”从本地 HBM 扩展成跨设备、跨介质、可编排的系统级视图,这正是存算网一体化的工程含义。

结语

何泽坤在分享结尾总结指出AI 基础设施竞争正在从 GPU 之战走向效率之战。前一阶段行业关注的是卡数、FLOPS、HBM 和交付周期。下一阶段,是数据中心、电力、存储、网络、计算与调度的整体协同效率。对产业界而言,核心目标并非堆砌硬件资源,而是持续降低单token成本,保障任务以更低时延、更高完成率稳定运行。他强调,Agentic AI正推动基础设施从“算力中心主义”转向“系统协同主义”,存储层级优化、网络总线化升级与统一调度能力,将成为下一阶段AI基础设施演进的核心变量,为行业高质量发展注入新动能。

ODCC网络工作组联系人

孙老师 suncong@caict.ac.cn

ODCC秘书处联系人

刘老师:13488889649 邮箱:liupengyun@caict.ac.cn