ODCC | 首发KV Cache评测结果:焱融YRCache实现推理提速降本双突破

随着大模型发展从能力竞争逐步进入规模化推理部署的新阶段,越来越多的企业级应用正加速落地,也因此推理系统的性能、成本与资源利用率等评价指标逐渐成为业界关注的焦点。在这一演进过程中,存储作为 AI 基础设施核心支撑环节,正从传统的存力保障走向释放AI算力、重构推理内存墙边界的战略支点。

ODCC AI存储实验室

为系统评估算力中心的“存力”水平、打通技术研发与产业应用壁垒,在NVIDIA、美团、三星、Solidigm等产业链领军企业支持下,ODCC成立AI存储实验室。针对推理场景中的数据响应瓶颈,实验室聚焦大模型推理中的关键制约因素—KV Cache,启动面向存储软硬件的专项协同测试工作,旨在构建一套适配推理场景的KV Cache存储解决方案及测试规范,切实推动AI存储技术的标准化、规范化与规模化落地。

ODCC AI存储实验KV Cache评测环境

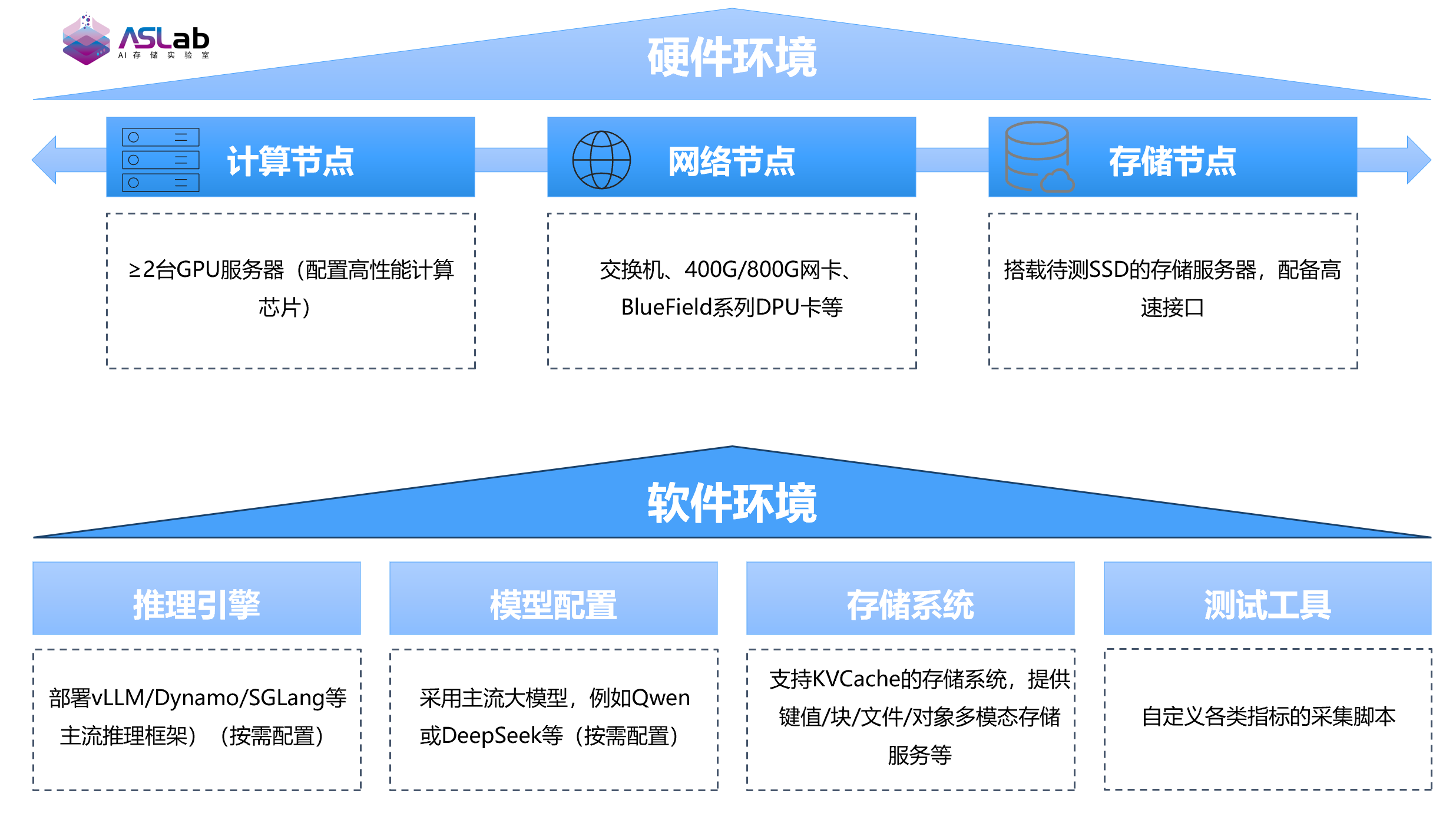

一、测试方案:

聚焦KV Cache,打造多级缓存架构

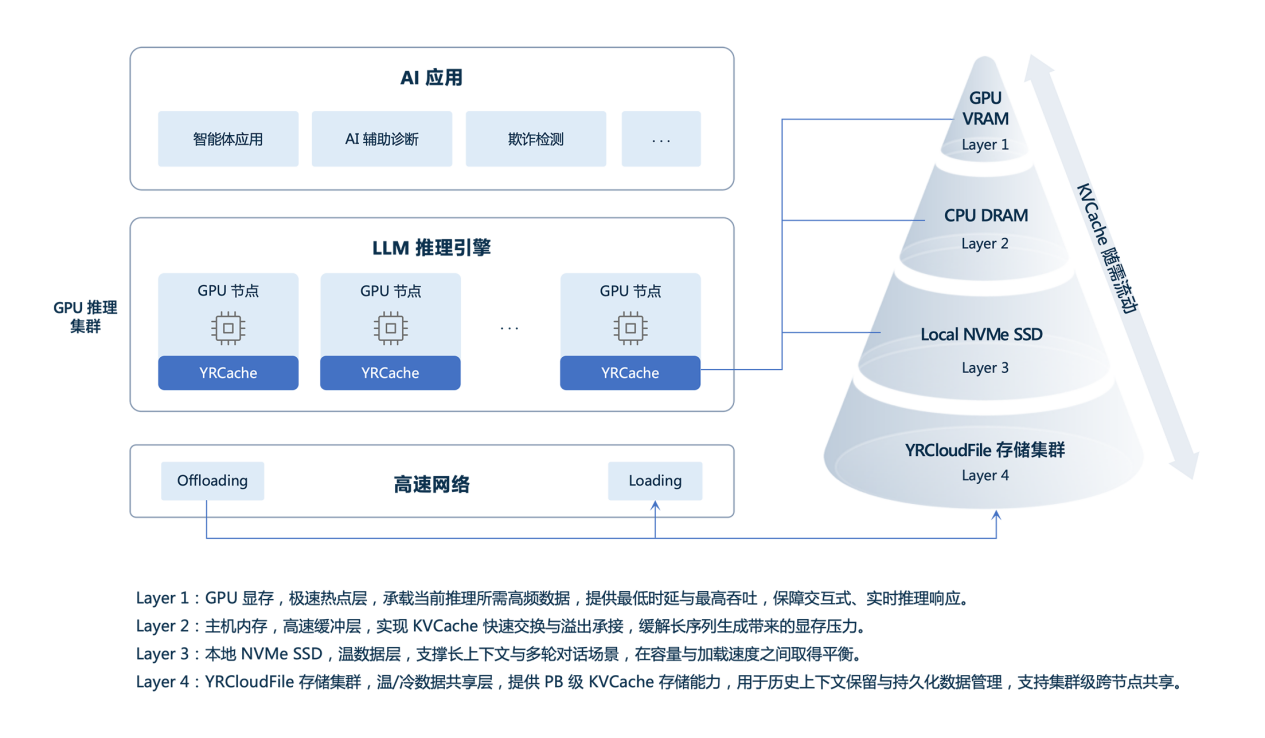

本次测试对象为焱融科技自主研发的YRCache 推理存储系统。该系统专为大规模推理场景设计,是面向KV Cache的存储管理平台。经测试,通过构建GPU显存、主机内存、本地NVMe SSD以及YR CloudFile高性能分布式文件存储的多级KV缓存架构,YRCache能够显著扩展KV缓存空间,大幅提升推理性能。

YRCache 架构图

二、测试环境:

构建典型算网配置,紧贴真实推理场景

本次测试主要验证了PD(Prefill-Decode)一体场景下,基于DeepSeek-R1等主流大模型,对比原生vLLM框架与集成YRCache后的系统,在不同网络配置(200Gbps/400Gbps/800Gbps)下的性能表现。

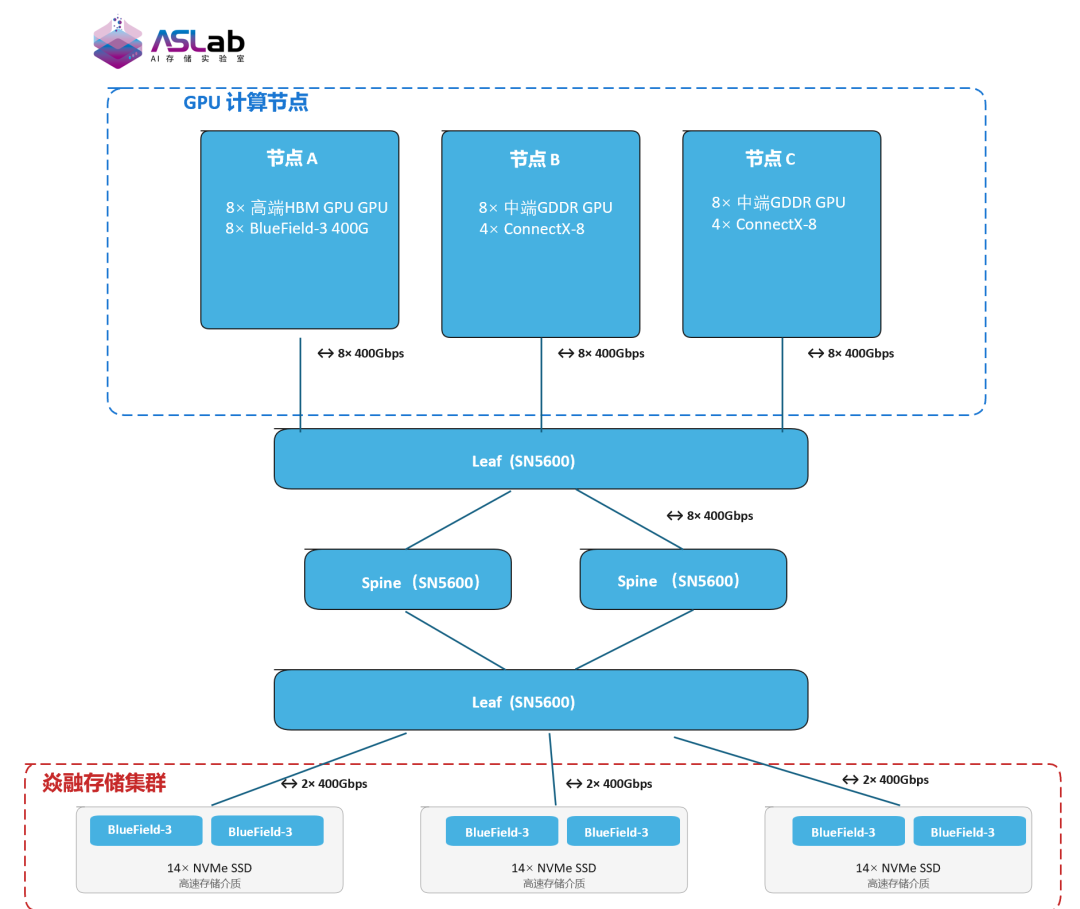

在GPU计算节点选型上,测试引入两类具有代表性的服务器配置:一类为中端GDDR GPU服务器,对显存容量与带宽资源较为敏感,可代表中端性价比导向的推理节点;另一类为高端HBM GPU服务器,具备更高的显存容量与带宽,单卡计算性能更强,适用于高吞吐推理负载。通过这一组合,可全面评估YRCache在不同显存层级与算力梯度下的优化效果,也使测试环境更贴近企业在实际部署中面临的多样化硬件条件。

测试环境网络拓扑架构图

三、核心成果:

性能跃升、长上下文支持与成本重构

1、推理性能实现数量级提升

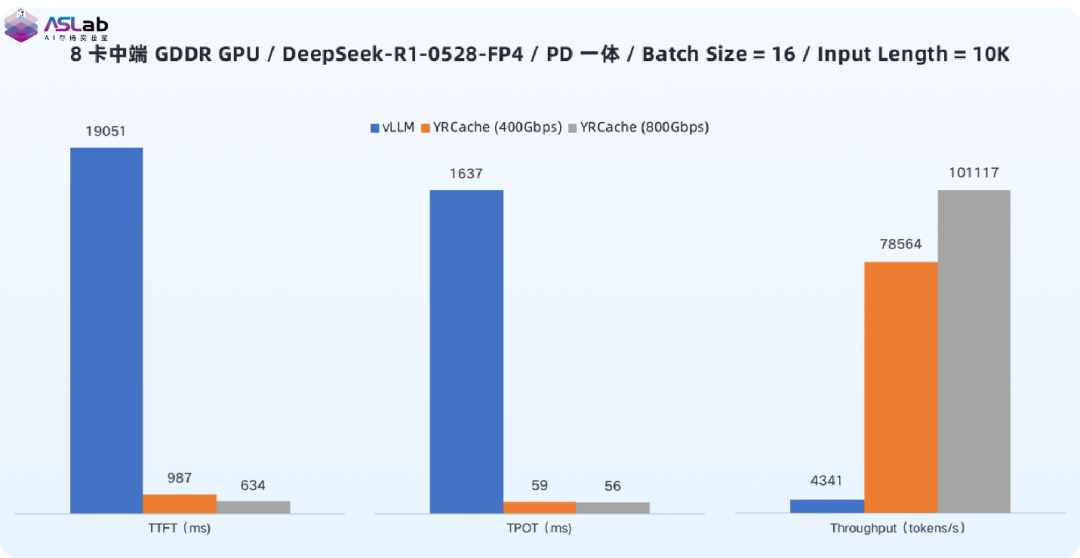

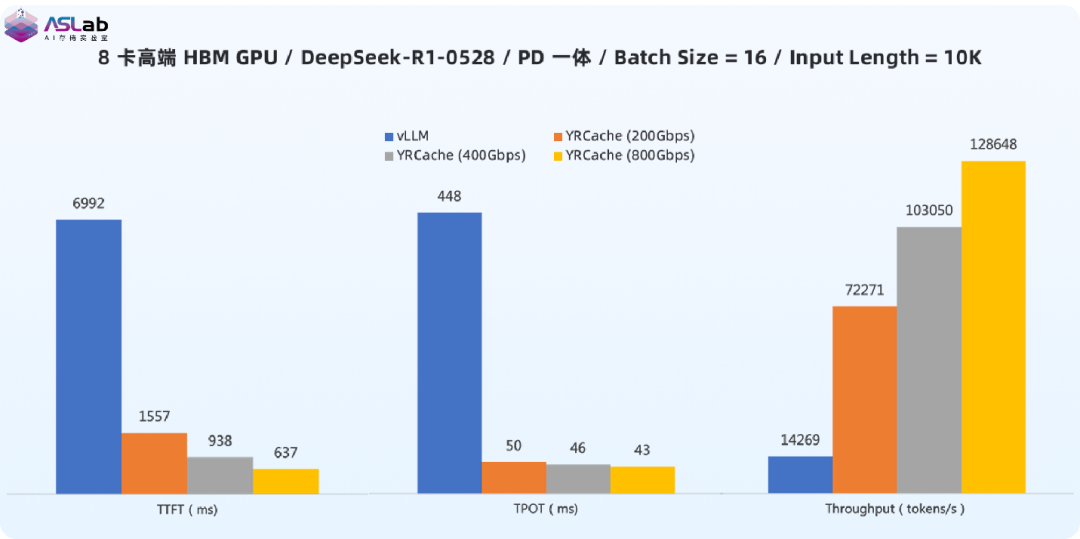

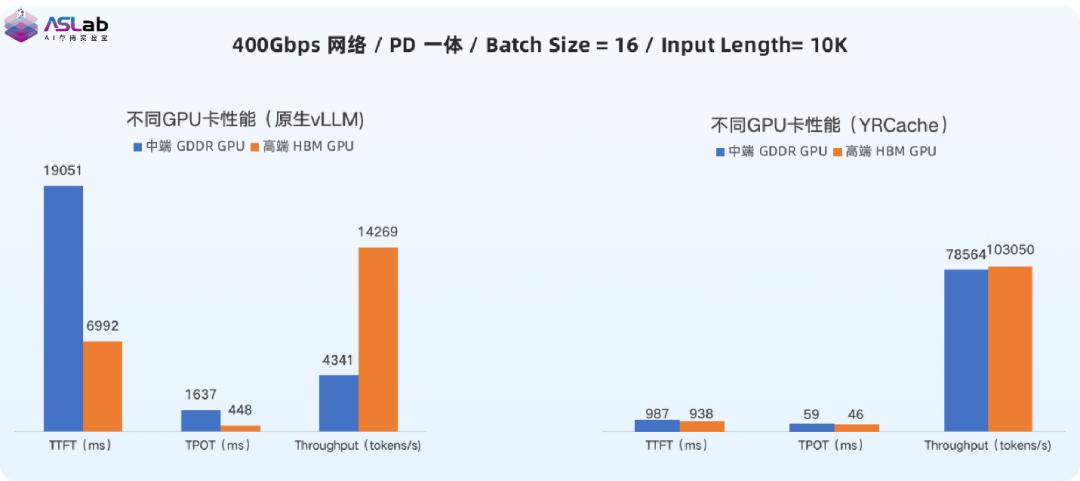

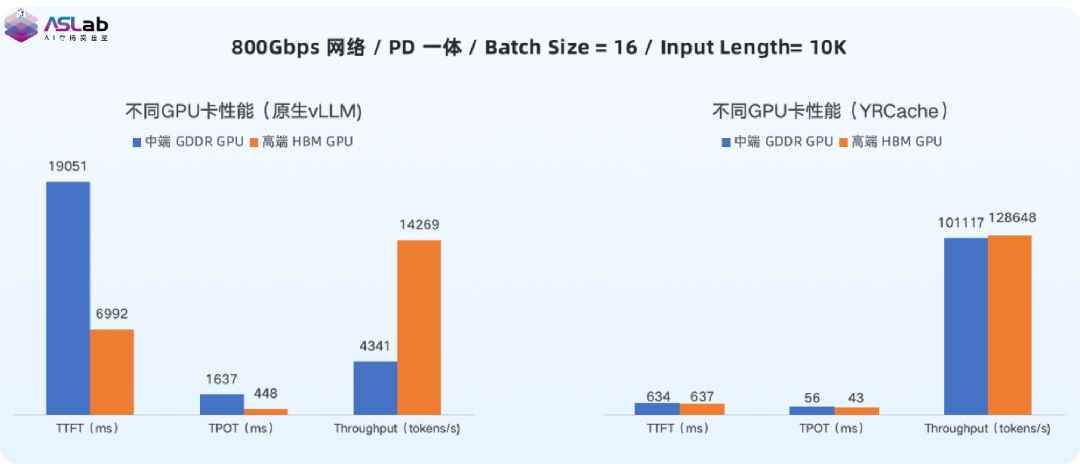

在batch值为16、输入Token长度为10K的典型环境下,针对不同GPU服务器及多种网络配置的测试结果如下图所示。结果表明:首Token延迟(TTFT)和单个Token输出时间(TPOT)均优化90%以上,Token吞吐量提升约20倍左右。

从测试结果可以看出,用户将在实际的体验中获得即问即答的交互;长文档生成过程更加高效流畅;同时系统能够服务更多并发用户请求,单 Token 推理成本也同比例降低,为高性价比的AI服务落地提供基础保障。

2、长上下文场景的高效支撑

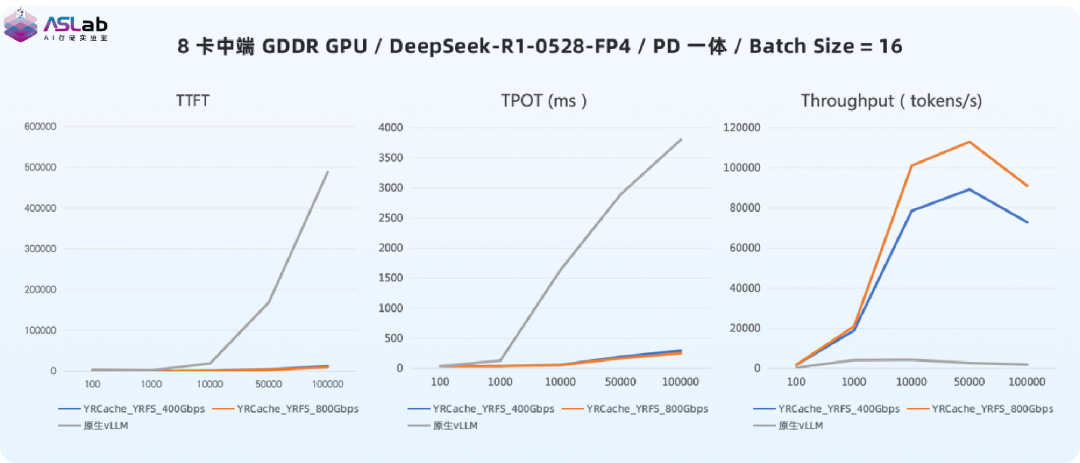

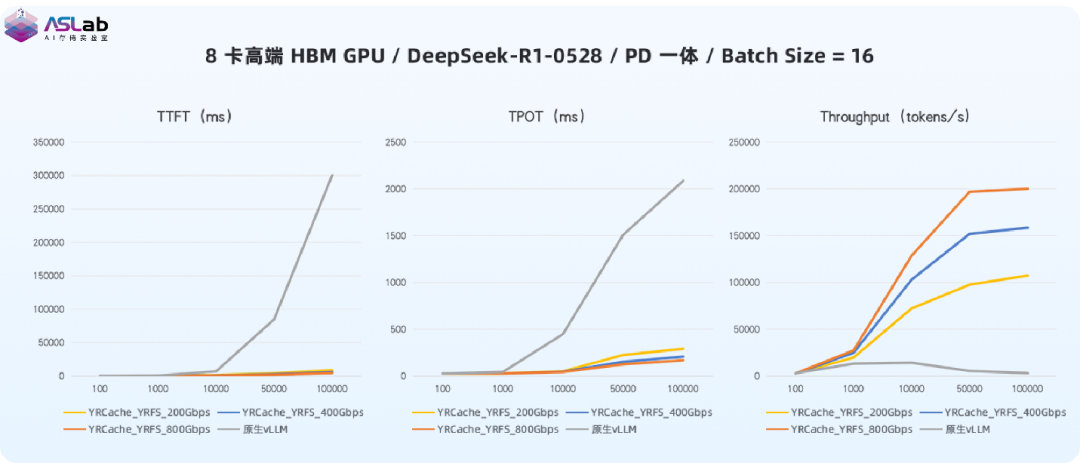

在模拟长上下文场景的测试中,随着输入Token长度从100逐步扩展至100K,YRCache始终保持稳定的性能优势,且其加速效果随上下文长度增加而持续放大,展现出显著的可扩展性,具体测试性能表现如下图所示。

从测试结果可以看出,YRCache为企业在实际部署长文档分析、代码生成、多轮对话等高负载、高复杂度任务时,有效规避因任务规模扩大而导致的性能下降,提供坚实且实用的技术底座。

3、推理成本的革命性优化

在不同GPU平台及网络配置下的对比测试表明,通过引入YRCache,中端GDDR GPU的综合推理性能显著提升,已接近甚至在部分场景下媲美高端HBM GPU原生方案,具体测试表现如下图所示。

从测试结果可以看出,在相同条件下,“+ YRCache” 可使得中端GDDR GPU实现远超高端HBM GPU原生方案的推理产出效率,带来显著的成本效益优化,重构了企业AI推理的成本结构。对于正处于商业化关键阶段的AI企业而言,这一突破不仅意味着性能与成本的双重优化,更代表着商业模式的深层变革——当推理成本的重心从依赖高端GPU转向依托存储技术创新,AI应用的盈亏平衡点将大幅下移,大量此前受限于经济可行性的创新场景由此获得落地可能。

四、迈向“存储驱动推理”的新范式

本次测试旨在评估基于NVIDIA计算和网络平台的测试环境下,YRCache对推理性能的提升效果,标志着“以存促算、架构降本”的AI推理基础设施的新路径。作为ODCC AI存储实验室的重要实践,该测试为行业提供了可复用、可量化的技术参考,也为构建高性价比、高效率的智算底座树立了标杆。

未来,AI存储实验室将持续推进KV Cache系列测试,深化“部件—系统—应用”全栈协同,携手产业伙伴,以“数量级性能提升 + 颠覆性成本优化”,助力企业在AI规模化落地浪潮中抢占先机。KV Cache系列测试已开始第二期,欢迎感兴趣的存储软件、存储部件及计算设备企业加入!

ODCC AI存储实验室联系人

段老师:16600265822

谢老师:18800199616

ODCC秘书处联系人

刘老师:13488889649 邮箱:liupengyun@caict.ac.cn